Un informe mostró que, incluso a perfiles similares y con los mismos gustos, no se les muestran las mismas noticias.

La fundación World Wide Web Foundation realizó una investigación para demostrar cómo funciona el algoritmo de Facebook a la hora de mostrarles noticias a sus usuarios, sobretodo cuanto se trata de perfiles similares con intereses idénticos.

Para esto, el equipo de investigación de la fundación, que aboga por democratizar el acceso a la información, realizó un trabajo publicado con el título «La mano invisible: el News Feed de Facebook y nuestra dieta informativa», donde detallan su experimento.

Los investigadores hicieron la siguiente actividad: crearon seis cuentas falsas en Facebook, correspondientes a mujeres de 30 años. No agregaron ningún otro dato. Luego, esas usuarias siguieron a las mismas 22 fuentes de noticias. Entre ellas había medios de alcance nacional y, también, los perfiles del presidente Mauricio Macri y de Cristina Kirchner. Para evitar cualquier discrepancia en la prueba, todos los perfiles se conectaban a la misma hora.

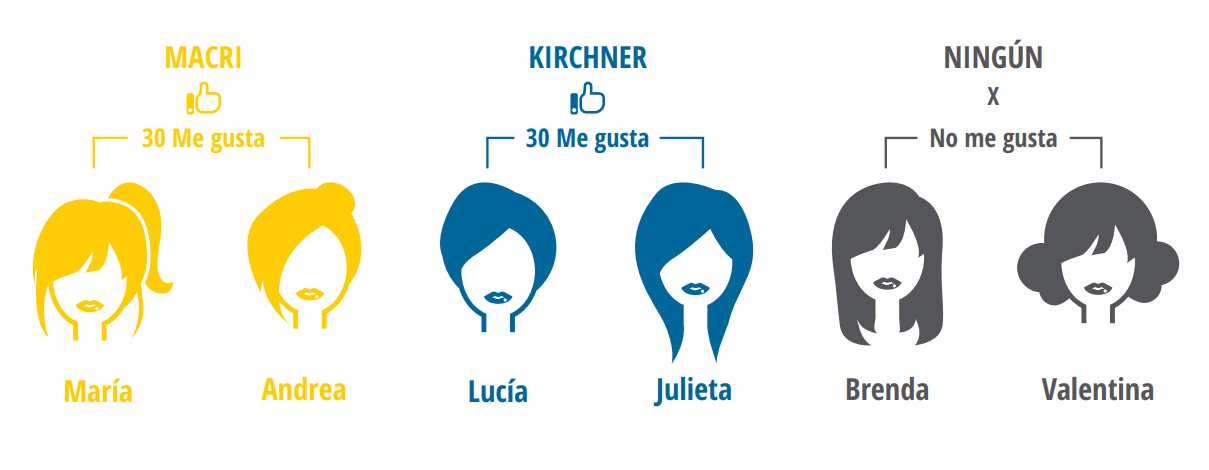

El trabajo, que comenzó el 8 de diciembre de 2017, tuvo una segunda parte una semana después, el 15 de diciembre. Ahí, dos de esas cuentas le dieron «Me Gusta» a una gran cantidad de publicaciones de Mauricio Macri; otras dos a posteos de Cristina; y las dos restantes no hicieron nada, como una suerte de grupo de control. A partir de ahí surgía el objeto de estudio: cómo cambiaba -si es que cambiaba- el contenido noticioso que se le mostraba a cada perfil.

En ese momento nació la tercera etapa: en los siguientes 11 días, las 22 cuentas de noticias publicaron 11.603 notas, pero solo el 18 por ciento fue mostrado a todos los perfiles. Para el resto de ellos, Facebook seleccionó contenido diferente incluso para los usuarios que tenían características similares.

«Los perfiles seguían las mismas páginas, y de todas las noticias publicadas por éstas, únicamente se les mostró un promedio de una de cada seis publicaciones. Una brecha tan amplia entre lo que se ve y lo que se oculta permite aproximarse al grado de curaduría de contenido (es decir, la selección, distribución y difusión de contenidos que tiene lugar en la plataforma)», detallaron los investigadores en el informe. Dicho de otra manera, desde la World Wide Web Foundation explicaron que, esta situación, es como si «dos personas compraran el mismo periódico impreso, pero descubrieran que se han suprimido diferentes conjuntos de historias de sus ejemplares. El algoritmo coloca a cada usuario en una versión separada e individualizada de lo que debería ser una plaza abierta y pública de información».

En ese sentido, dieron un ejemplo para retratar cómo se dio la selección de material. «Durante el período observado, ninguna de las historias sobre femicidios publicadas por las páginas que nuestros perfiles seguían aparecieron en el News Feed de nuestros usuarios», detallaron.

Los resultados, en detalle

Los perfiles falsos, que se movían en la red social al mismo tiempo para disminuir la brecha de error al mínimo, fueron creados bajo los nombres Lucía, Julieta, Brenda, Valentina, María y Andrea.

«No es ningún secreto que Facebook desempeña una función de filtrado basado en los perfiles de usuario para clasificar la inmensa cantidad de información que se publica en la plataforma social», arrojó el informe pero aclaró un punto en relación a ello: «Los hallazgos de nuestro estudio sugieren que esta forma de filtrar los contenidos a distribuirse se extiende a usuarios con perfiles aparentemente idénticos. Por ejemplo, de las 11.603 publicaciones publicadas durante los 11 días observados, Andrea solo vio 1.192 publicaciones, y nuestros seis perfiles combinados estuvieron expuestos únicamente a 2.071 publicaciones, tan solo el 18 % de todas las publicaciones publicadas en las 22 páginas de Facebook». De esta forma, esto equivale a estar expuesto a alrededor de una de cada seis publicaciones de todos los sitios que se siguen. «Pero es importante destacar que Andrea fue sometida a una experiencia muy distinta a la de Lucía: a pesar de seguir las mismas páginas y conectarse a la red social al mismo tiempo, aproximadamente la mitad de los componentes de la dieta informativa de Andrea fue excluida de la línea de tiempo de Lucía, y viceversa».

Desde la fundación subrayaron la importancia de este estudio, apoyándose en la importancia que le dan los argentinos a la red social a la hora de informarse. «En la Argentina, 65% de la población recurre a Facebook como fuente principal de noticias. Por lo tanto, las decisiones sobre la información a la que se expondrá a los usuarios puede tener efectos profundos en nuestra política, economía y cultura. Estudios recientes muestran que el News Feed de Facebook tiene la capacidad de impactar en la cantidad de personas que deciden ir a votar en una elección, e incluso puede tener un pequeño–pero estadísticamente significativo– efecto en el estado de ánimo de los usuarios», alertaron.

https://infogram.com/cantidad-de-posteos-por-medio-1hzj4ole07j34pw

Al respecto, consultados por el diario La Nación, desde Facebook explicaron: «No favorecemos ciertos tipos de fuentes ni ideas. Nuestro objetivo es entregar las historias que, según hemos aprendido, le interesan más a un individuo. Cuando la gente ve contenidos que le interesan, es probable que pasen más tiempo en el News Feed y disfruten de la experiencia», dijeron.

En ese sentido, Ana Clara Prilutzky, gerenta de Comunicaciones de la red social en la Argentina, aseveró: «La sección de Noticias de cada persona en Facebook es única y está diseñada para que encuentren el contenido más relevante para cada una de ellas. Lo que cada persona ve es determinado por sus intereses e interacciones con otras personas, Páginas, noticias, negocios y contenidos», explica Ana Clara Prilutzky, Gerente de Comunicaciones de Facebook Argentina. Existe una fórmula que valora las publicaciones de amigos y familiares, primero (esto no era así cuando se hizo el experimento), luego las noticias y el contenido entretenido.